Wenn die erste Linie reißt — was springt ein? Eine Hypothese.

LogPy ist eine Forschungs-Initiative für eine zweite Linie der gesellschaftlichen Koordination — Bottom-up (von unten, aus den Menschen heraus, nicht von Behörden angeordnet), am Körper, augmentiert durch Multi-Agent-Systeme. Als Orchestrator-Substrat nutzt LogPy AgentClaw, ein lokales Multi-Agent-Framework. Hier skizziere ich eine Hypothese, die sich aus existierenden Komponenten und ein paar Zufällen ergeben hat — eine LoRa-Doku auf Arte gab einen der Anstöße: ob das Substrat eine Schicht tragen könnte, die einspringt, wenn die erste Linie reißt. Drei-Tier-Architektur (Wearable, Mesh-Peers, Resilience Centers), Antifragilität als Möglichkeit, klare Risiko-Achse. Krise ist Lackmustest, nicht Selbstzweck. Ich weiß nicht, ob das geht. Ich will herausfinden, ob es geht.

Wo die erste Linie reißt

Es gibt einen Grund, warum ich ungerne mit dem Ahrtal anfange. Ich will aus 2021 keine emotionale Vorlage machen, kein Schock-Argument, keine Einleitung, die mit Wunden hantiert.

Aber es war ein Signal. Heute, ein paar Jahre danach, mit Werkzeugen die es damals in dieser Form noch nicht gab, lesen wir es genauer.

Was gerissen ist, war nicht nur Infrastruktur. Es war die stille Annahme, dass eine Linie der gesellschaftlichen Koordination unter allen Lasten hält. Telefon weg, Funk überlastet, Behörden überfordert. Menschen wussten nicht, wer noch lebt, wer wo ist, wer Hilfe braucht. Hilfe kam. Aber spät. Manche zu spät.

Das Signal sagt nicht „macht die Behörden besser.“ Behörden waren nicht das Problem — sie waren überlastet wie vorhersagbar. Das Signal sagt: „die Annahme, dass eine Linie reicht, war falsch.“

Klimakrisen werden nicht weniger, Cyber-Angriffe auf Strom und Wasser sind keine Theorie mehr, Hilfsorganisationen verlieren Personal während die Lagen wachsen. Was im Ahrtal sichtbar wurde, wird sich wiederholen — in anderen Regionen, anderen Formen, mit anderen ersten Linien die brechen.

(gdg: nein, es hat sich aus den Komponenten ergeben!)Ich frage mich seit Monaten: was wäre, wenn es eine zweite Linie gäbe? Eine, die einspringt, wenn die erste nicht reicht. Bottom-up, von Mensch zu Mensch, augmentiert durch Maschinen, die wir am Körper tragen.

Ich weiß nicht, ob das geht. Aber ich will herausfinden, ob es geht. Die Initiative dahinter heißt — bei mir — LogPy.

Wie es mit dem System ausgesehen hätte

Vorab: Mesh-Funk, Wearables, P2P-Protokolle — die Bauteile gab es 2021. Was es nicht gab, waren KI-Modelle, die das Ganze brauchbar auf ein Handgelenk hätten bringen können. Heute gibt es sie. Knapp, aber sie sind da. Deshalb kann ich diese Vignette jetzt schreiben und hätte sie vor vier Jahren noch nicht schreiben können.

(gdg: zu komplex, es muss in 1 min klar werden was das system ist, video_todo)

Stell dir die Nacht vom 14. Juli 2021 noch einmal vor. Diesmal mit dem System am Handgelenk.

22:47 Uhr. Strom flackert seit zwanzig Minuten. Mobilfunk: ein Balken, dann keiner. Du checkst dein Smartphone — WhatsApp lädt nicht.

Dein Gerät am Handgelenk vibriert. Nicht laut, nicht alarmistisch.

Pegel Ahr lokal: 4,7 m, vor 90 s gemessen. Tendenz steigend 18 cm/min. Anstiegs-Geschwindigkeit: ungewöhnlich. Empfehlung: Anhöhe erreichen. Konfidenz: hoch. Quelle: 3 Mesh-Peers + Tier-3 Pegelarchiv-Schnittstelle.

Du tippst „Familie“.

Vater (verifiziert), vor 8 Min als Träger gesehen, aktuell offline. Letzte bekannte Position: zu Hause. Halbwertszeit der Aussage: 15 Min unter aktuellen Bedingungen.

Eine Karte. Zwei Routen zu seinem Haus. Eine grün („Brücke West, Konfidenz hoch, 12 Min berechnet“), eine rot („Talweg, Wasserstand steigt rapide, nicht empfohlen, Konfidenz hoch“).

Über dem Eintrag eine Zeile: Berechnete Zeit, nicht erfahrene. Plane Stress-Reserve ein.

Du gehst los.

Unterwegs meldet sich ein:e Nachbar:in zwei Häuser weiter. Verifizierter Skill: Erste Hilfe. Bietet an, gemeinsam zu gehen — sie hat einen Akku für Funkgeräte, du nicht. Eure beiden Geräte koppeln im lokalen Mesh.

Behördennetze sind weiter überlastet. Aber ihr seid nicht alleine unterwegs. Sieben Träger im 800-Meter-Radius, das System weiß das, ohne dass es jemand zentral koordiniert.

So hätte das ausgesehen. Nicht als Wunder. Als Schicht, die einspringt, wenn die andere bricht.

Was schon steht

Eine kurze Begriffsklärung, weil die Layer wichtig sind: LogPy ist die Initiative — das gesamte System mit Brand, Front, Identity-Stack, Mesh-Schicht. AgentClaw ist die Orchestrator-Engine darin, ein lokales Multi-Agent-Framework, das in mehreren Phasen entstanden ist. AgentClaw hat Wert auch außerhalb von LogPy (alltägliche Multi-Agent-Anwendungen am eigenen Mac). LogPy nutzt AgentClaw als Kernel und baut Mesh, Tier-3-Architektur und Public-Front darum herum.

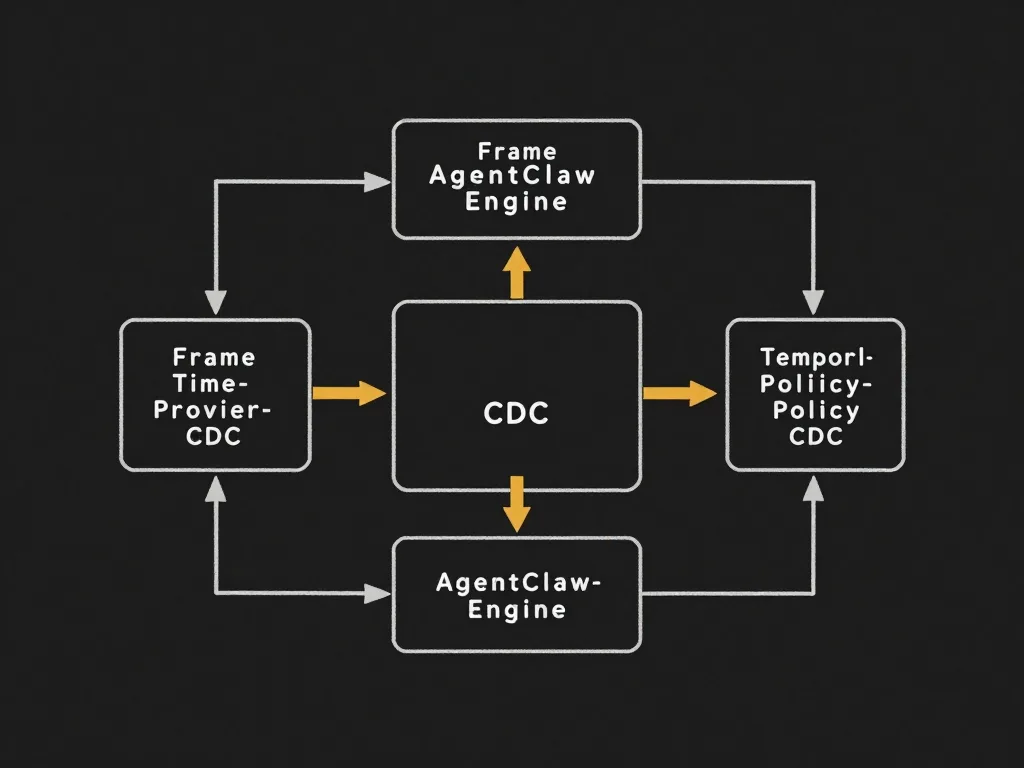

Was AgentClaw als Substrat heute trägt:

- Frame-Architektur — jeder Agent hat eigene Reasoning-Frames, versionierte Reads, kausale Ordnung.

- Time-Provider mit Eigenzeit — schnelle Agents (kleine Modelle) und langsame Agents (Frontier-Modelle) haben unterschiedliche Eigenzeiten (γ), gegen die Drift gemessen werden kann.

- Causal Dilation Clock (CDC) — eine Datenstruktur, die Cross-Agent-Merges in vier Relationen klassifiziert: ordered, causal-drift, concurrent-drift, inconsistent.

- Temporal-Policy — Side-Effect-Skills (Mail, Telegram, LinkedIn) werden bei zu großem Drift abgelehnt, statt blind ausgeführt zu werden.

Parallel auf dillenberg.net: unter rent-a-human.dillenberg.net läuft seit 2026-05-04 ein A2A-spec-konformer Agent-Endpoint (JSON-RPC 2.0, AgentCard, SendMessage/GetTask). Das ist der erste produktive Agent-zu-Agent-Test, den ich im offenen Netz fahre.

Das Substrat trägt heute Single-Agent-Use-Cases. Die Frage in diesem Paper ist: könnte es auch ein gesellschaftliches Mesh tragen?

Drei Tiers, drei Verfügbarkeiten

Die naive Frage „lokal oder Cloud?“ hat eine naive Antwort: weder noch. Die Architektur, die ich zur Diskussion stelle, hat drei Schichten — jede mit eigener Verfügbarkeit und eigenem Kompromiss zwischen Resilienz und Leistung.

Tier 1 — Personal Device (am Körper)

Ein Wearable oder Smartphone mit einem kleinen LLM (3–7B Parameter, NPU-beschleunigt). Verbindet sich über LoRa, Bluetooth oder Mobilfunk. Konkrete Hardware-Skizze: → LogPy — der Communicator.

Verfügbarkeit: immer.

Stärke: persönlich, privat, jederzeit ansprechbar.

Schwäche: kleines Modell, begrenzter Kontext.

Tier 2 — Mesh-Peers (~10 km Radius)

Andere LogPy-Träger in lokaler Funkreichweite. LoRa-Mesh, Bluetooth-Mesh oder lokales WLAN. Compute wird gepoolt, Skills werden geteilt, Lagebild entsteht aus den Sensoren mehrerer Träger.

Verfügbarkeit: opportunistisch.

Stärke: emergente Intelligenz, keine zentrale Abhängigkeit.

Schwäche: braucht Träger-Dichte, niedrige Bandbreite, Latenz.

Tier 3 — Resilience Centers

Gehärtete Rechenzentren mit garantierter Mindest-Laufzeit (X Stunden via USV / Diesel / Solar). Frontier-LLMs, Storage, Cross-Region-Routing. Erreichbar primär über Internet, sekundär über LoRa-Gateway.

Verfügbarkeit: garantiert in Zeitfenstern, planbar.

Stärke: massive Capability, persistente Logs, große Modelle.

Schwäche: nicht überall, nicht immer, Governance-Frage offen.

Tier 3 ist optional, aber wenn erreichbar, ein Capability-Uplift. Der Agent priorisiert: reicht Tier 1 für die Aufgabe → solo. Tier 2 erreichbar und nützlich → kollaborieren. Tier 3 erreichbar und Aufgabe groß → eskalieren.

Das System funktioniert auf jedem einzelnen Tier. Es wird besser mit jedem zusätzlichen Tier. Kein Tier ist Single Point of Failure. Das ist graceful degradation by design — das Standard-Pattern aus verteilten Systemen, übertragen auf gesellschaftliche Infrastruktur.

Das Vorbild für Tier 3 sind Tor Directory Authorities und IPFS Pinning Services: spezialisierte, opportunistisch nutzbare Knoten, die das Netz nicht brauchen, aber stärker machen, wenn sie da sind.

Was zwischen den Tiers passiert

Drei Substrat-Layer müssten zusammenkommen, damit das Mesh überhaupt möglich wird.

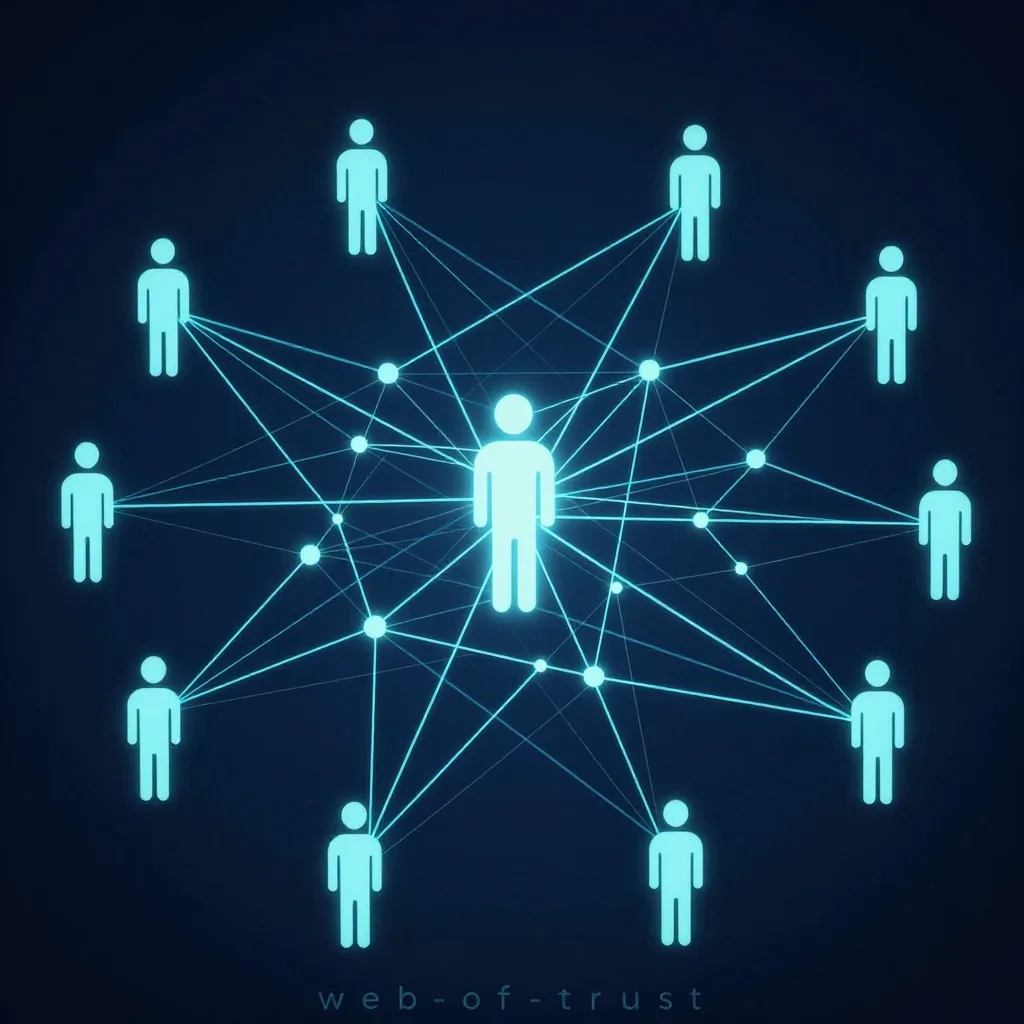

Identity. Jeder Agent hat eine kryptografische Identität, mit der er sich gegenüber anderen Agents authentifiziert. Web-of-Trust, ohne Certificate Authority, ohne Big-Tech-Anchor. Reputation wird lokal geführt: dein Agent vertraut den Agents, mit denen er gute Erfahrungen gemacht hat — und übernimmt vorsichtig Vertrauen aus deinem unmittelbaren Umfeld.

Time und Order. In einem Mesh ohne synchronen Wall-Clock (kein NTP über LoRa, RTC-Drift auf billiger Hardware, lange Offline-Phasen) braucht es Hybrid Logical Clocks für kausale Ordnung. Die γ-Achse aus AgentClaw liefert zusätzlich Aufwand-Information: wer hat seit dem letzten Sync wieviel nachgedacht? Das ist beim Merge zweier Agents die Differenz zwischen „du bist hinterher“ und „du bist auf einer anderen Spur“.

Routing und Capability-Discovery. Ein Agent, der Hilfe sucht, broadcastet sein Bedürfnis lokal. Andere Agents prüfen, ob sie passen — Skill, Distanz, Verfügbarkeit. Die A2A-Spec gibt das technische Vokabular vor; das Skill-Matching darüber wäre eigener Beitrag.

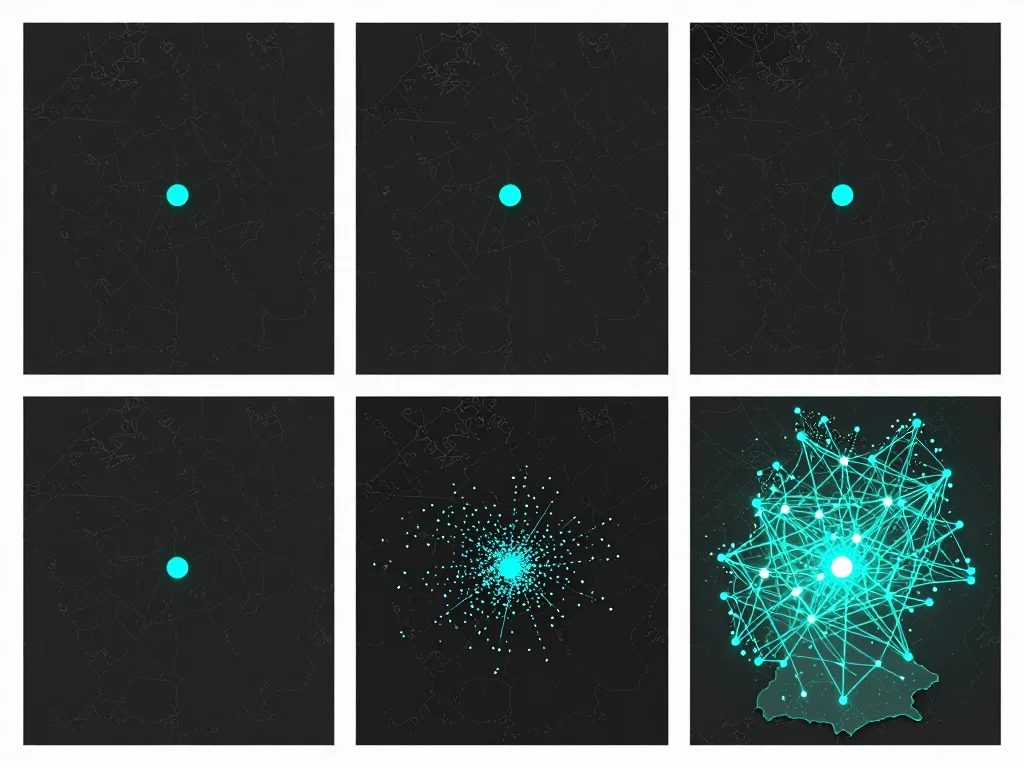

Vier Phasen — der Adoption-Pfad

Das Mesh entsteht nicht durch Verkündigung, sondern durch Adoption. Damit Adoption funktioniert, muss jede Phase auch alleine wertvoll sein. Die Phase darunter darf nicht auf die Phase darüber warten müssen.

| Phase | Was es leistet | Wert pro Träger | Mindest-Adoption |

|---|---|---|---|

| A | Solo-Agent: persönliche Produktivität | sofort | keiner |

| B | Lokales Skill-Matching, Mutual Aid in der Nachbarschaft | mittel | ~3 % lokal |

| C | Krisenkoordination, Schwarm-Triage | hoch (selten) | ~10 % regional |

| D | Gesellschaftliche Resilienz-Schicht | systemisch | ~20 % national |

Phase A muss eigenständig tragen. Das ist die kritische Bedingung. Wer einen LogPy-Träger nicht überzeugt, dass das Gerät am ersten Tag nützlich ist, wird die Phasen B–D nie erreichen. Das ist die Lehre aus allen vergleichbaren Mesh-Networks der letzten 15 Jahre — Meshtastic, Briar, Helium, Bridgefy. Alle technisch solide, alle bei Cold-Start gestrandet.

Krise als Lackmustest

Wir reden über Krisen, weil sie zeigen, was sonst unsichtbar bleibt. Aber das Mesh ist nicht für Krisen gebaut, sondern getestet an ihnen.

Das kanonische Szenario: Vulkanausbruch im Umkreis von 10 km. Mobilfunk überlastet, Strom unzuverlässig. LogPy-Träger im Gebiet vernetzen sich über LoRa und lokales WLAN. Lagebild entsteht aus den Sensoren der Träger. Skills werden lokal gematcht: drei Personen mit Medikamentenbedarf, zwei mit Erste-Hilfe-Ausbildung, einer mit Geländewagen — die Agents schlagen ein Treffen vor, Menschen entscheiden. Wenn ein Resilience Center erreichbar ist, läuft das Routing über dort; wenn nicht, lokal.

Ich bin in dieser Beschreibung ehrlich vorsichtig. Real ist Krise messy. Das Kind weint, der Erste-Helfer hat eine Panikattacke, der Patient stirbt unterwegs. Algorithmen scheitern dort, wo Improvisation gebraucht wird. Was das Mesh kann, ist: Vorschläge machen, Friction zwischen Helfenden reduzieren, Lagebild teilen. Was es nicht kann: die Krise „lösen“.

Ein zweites Beispiel, das mir wichtig ist, weil es zeigt wo die Schicht gefährlich werden könnte: ein Agent kann Familien zusammenführen — „dein Bruder ist im Sektor 3, hier der kürzeste Weg“ — er kann es aber auch nicht tun, wenn die Risikoabschätzung etwas anderes sagt (Trümmer-Gebiet, Gas-Leck, vermutete Gewaltsituation). In beiden Fällen gilt eine Regel, die ich für nicht-verhandelbar halte: die Empfehlung trägt immer das Entscheidungs-Level mit. Auf welcher Information beruht sie? Mit welcher Konfidenz? Aus welcher Quelle? Wann wurde diese Information zuletzt gemessen, und wie schnell veraltet sie? Und am wichtigsten: ist die Zeit darin berechnet oder erfahren? Ein Agent, der „du hast 20 Minuten Zeit“ sagt, sagt etwas mathematisches — keine erfahrene menschliche Zeit, die unter Stress dehnt und unter Müdigkeit staucht. Das muss er als „berechnet, nicht gefühlt“ markieren, damit der Mensch mit eigenem Bauch korrigiert. Ein Agent, der „geh nicht dort hin“ sagt, ohne offenzulegen warum, ist ein Agent, der heimlich Macht ausübt. Genau das wollen wir nicht.

Der ehrliche Anspruch ist also: Sekunden gewinnen, Doppelarbeit verhindern, Wissen finden, das sonst verloren geht — und Entscheidungen sichtbar machen, statt sie wegzuautomatisieren. Nicht: die Katastrophenschutzbehörde ersetzen.

Die Risiken, die wir mitdenken müssen

Eine Vision ohne ehrliche Risikoanalyse ist Marketing. Hier sind unsere.

1. Vertrauen ist das eigentliche Kernfeature, nicht Skill-Matching. Wenn dein Agent dem Agent eines Fremden glaubt „ich bin Sanitäter“, was passiert, wenn das eine Lüge ist? In Krisen explodiert Vertrauen — gefakte Skills, Panik-Manipulation von außen, Bot-Schwärme die das Netz fluten. Die Identity- und Reputation-Layer sind 80 % der Komplexität. Skill-Matching ist 5 %. Wer das Trust-Problem nicht löst, baut nichts Tragfähiges.

2. Hardware existiert noch nicht im Mass-Market. Lokales Inferenz-fähiges Wearable, das einen ganzen Tag durchhält und ein 7B-Modell lokal fährt: 2026 noch nicht in der Form, die das Mesh braucht. Realistisch ist Smartphone-im-Pocket-Modus für die ersten Jahre. Das ist ok — es heißt nur, dass wir mit Form-Faktoren leben, die existieren, statt auf den perfekten Form-Faktor zu warten.

3. Cold-Start ist das Killer-Problem. Adoption ist nicht eine Frage von Tech-Eleganz, sondern von Wert-am-Tag-Eins. Wenn der Wert eines LogPy-Trägers erst nach 3 % lokaler Adoption beginnt, kommen die 3 % nie zusammen. Phase A (Solo) muss tragen, sonst bleibt es bei der Demo.

4. Tier-3-Governance — der heikle Punkt. Wer betreibt Resilience Centers? Staat → Single Point of Control. Privat → Single Point of Failure. Genossenschaftlich → noch nie im Maßstab erprobt. Das Tier-3-Modell ist der Punkt, an dem Top-Down zurückkriecht. Die Frage „wer betreibt“ entscheidet, ob das Mesh Resilienz bleibt oder Parallelstruktur wird.

5. Dual-Use ist real. Mesh + Identity + Skill-Matching ist neutrale Infrastruktur. Sie verstärkt, was reingeht. Mutual-Aid-Netzwerke werden damit besser. Selbstjustiz-Schwärme, gewaltbereite Gruppen mit Skill-Matching auch. „Wer nicht im Netz ist, gehört nicht dazu“ ist eine schreckliche Schwelle, die von selbst entsteht, wenn das Netz nützlich genug wird. Self-Limiting-Mechanismen müssen früh rein, sonst sind sie später nicht nachrüstbar.

6. LLMs haben mathematische Zeit, keine erfahrene. Ein LLM kann „240 Sekunden“ rechnen, aber es kann nicht fühlen wie sich 240 Sekunden in einer Krise mit weinenden Kindern anfühlen. Es kennt keine Stress-Dehnung, keine Müdigkeits-Stauchung, keine Schwankungs-Intuition für Sensor-Daten. Empfehlungen mit Zeit-Bezug („in 20 Minuten“, „dringend“, „bald“) müssen explizit als berechnet markiert sein, damit der Mensch mit eigenem Bauch korrigiert. Schwankungs-Erkennung in Sensorströmen ist nicht Sache des LLM — die liefert Statistik (Z-Score, Rate-of-Change), das LLM kontextualisiert sie. Trennung: Zahlen werden gerechnet, Sprache vom LLM. Niemals umgekehrt.

7. Die Verifikations-Welle kommt — die Frage ist nur wer sie baut. EU DSA + eIDAS 2.0, UK Online Safety Act, Australia U16-Ban, französisches SREN-Gesetz — Identity-Pflicht im Web wird Realität, ob wir es wollen oder nicht. Dazu kommt die Bot- und KI-Agent-Schwemme im offenen Netz, auch durch unsere eigenen Agents. Die ehrliche Frage ist nicht „Pflicht-Verifikation ja oder nein“, sondern „zentrale Top-down-Lösung (Apple/Google/Staat sammelt) oder selbstsouveräne Bottom-up-Variante (Träger trägt seine Identity, niemand sammelt sie zentral)“. LogPy positioniert sich als Bottom-up-Antwort, nicht als Verzicht aufs Thema. Wer „etwas Freiheit aufgeben für Sicherheit“ mit zentraler Datensammlung verwechselt, hat nur eine der beiden Varianten gesehen. Selektive Offenlegung + Web-of-Trust + Strafverfolgung-mit-Anordnung-aber-ohne-Default-Zugriff ist Achse-A-konform — verdrängen wäre Realitätsverweigerung.

Die Achsen-Entscheidung

Es gibt zwei Visionen, die technisch identisch aussehen, politisch aber Welten trennen.

Achse A — Resilienz-Schicht. Das Mesh hilft, wenn Institutionen überlastet oder ausgefallen sind. Es kooperiert mit Behörden, wo möglich. Es ist sonst unsichtbar. Es hat Self-Limiting-Mechanismen, die es daran hindern, Aufgaben zu übernehmen, die Institutionen besser leisten. Es ist anschlussfähig an eine offene Gesellschaft.

Achse B — Parallelstruktur. Das Mesh tritt als Alternative zu Institutionen an. Es verweigert Kooperation. Es ist „autonom im starken Sinn“. Es ist anschlussfähig an Akzelerationismus, Krypto-Anarchie, sezessionistische Strömungen.

Tech ist identisch. Wirkung ist gegensätzlich.

Mein Bauchgefühl ist klar: ich glaube an Achse A. Eine Schicht, die mit Behörden kann, nicht gegen sie. Die Strafverfolgung nicht unmöglich macht. Die Pseudonymität nicht erzwingt. Die Self-Limiting-Mechanismen im Code trägt, statt sie nur zu versprechen. Konkret heißt das mindestens:

- keine Eskalations-Aufrufe an Träger

- keine Verschlüsselung, die Strafverfolgung bei realen Verbrechen unmöglich macht — aber kein Default-Zugriff von Behörden, nur per richterlicher Anordnung gegen einen einzelnen Träger

- Identity ist Bottom-up und selbstsouverän: selektive Offenlegung pro Anwendung („ich bin >18″, „ich bin Sanitäter mit verifizierter Ausbildung“) ohne den vollen Namen freizugeben. Keine zentrale Datensammlung. Kein erzwungenes Anchoring an Staat oder Big-Tech. Web-of-Trust ohne CA.

- jede Agent-Empfehlung trägt das Entscheidungs-Level mit — Konfidenz, Quelle, Begründung, Alter der Datengrundlage, Halbwertszeit der Aussage, Zeit-Typ (berechnet vs. erfahren) — keine heimliche Macht durch Black-Box-Vorschläge

Mein Verstand weiß: das muss ich prüfen, nicht behaupten. Diese Forschungsphase wird die Bedingungen aufschreiben, unter denen Achse A überhaupt erhalten bleiben kann. Wenn sich die als unhaltbar erweisen, kommt das Paper offen zurück.

Was sicher ist: die Achsen-Entscheidung ist im späteren Verlauf irreversibel. Wer einmal auf B baut, kommt nicht zurück nach A. Wer ohne Self-Limiting startet, rüstet es nicht mehr nach. Deshalb gehört sie jetzt in die Diskussion, nicht später.

Was die Forschungsphase prüfen muss

Dieses Paper ist eine Hypothese, kein Produkt. Der nächste Schritt ist nicht ein Manifest, sondern ein Validator.

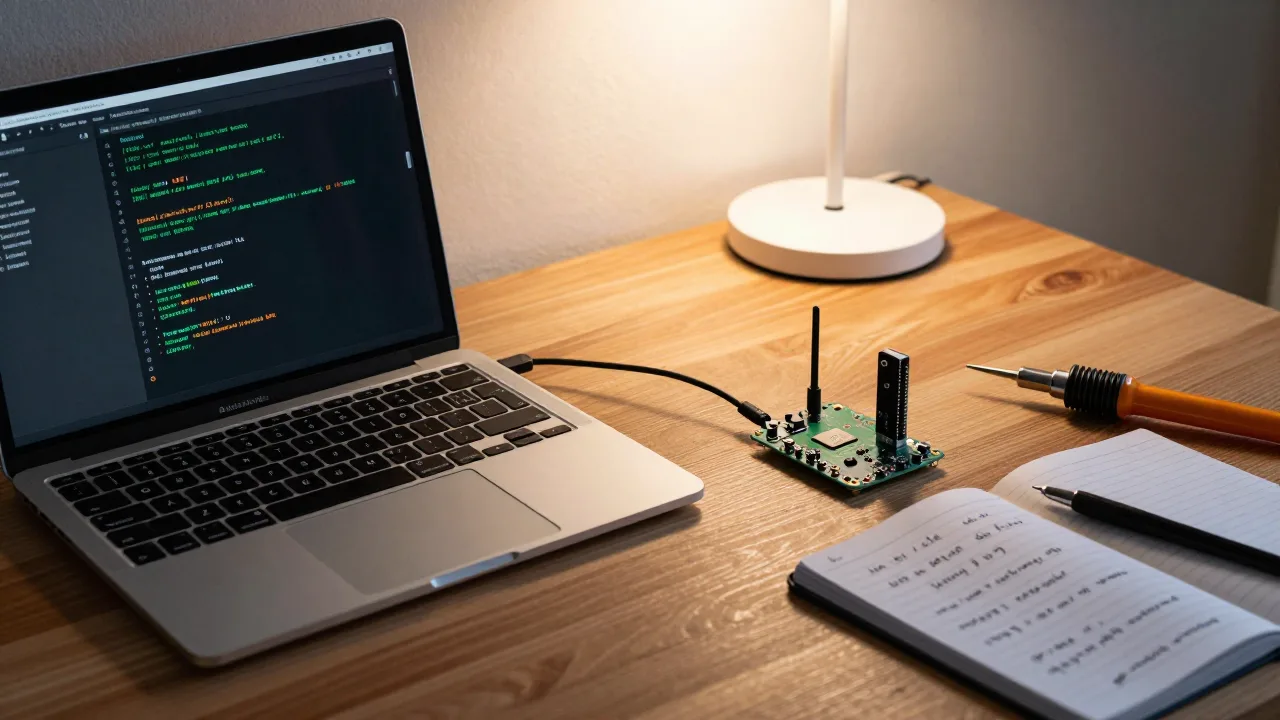

2-Device-Demo (4–6 Wochen, ~150 € Hardware). Ein Mac (vorhandene Infrastruktur) als „starker Agent“, ein Raspberry Pi 5 mit Hailo-NPU als „wearable proxy“. Bluetooth oder LoRa-Pair für die nicht-internet Strecke. Ein einziger E2E-Use-Case: ich diktiere dem Pi eine Aufgabe, der reicht sie an den Mac, der erledigt sie und syncs zurück. Drift-Reject einmal mit Wall-Clock, einmal γ-aware. Differenz messen.

Was die Demo beantworten soll:

- Funktioniert die Auth-Story zwischen zwei LogPy-Trägern (AgentClaw-zu-AgentClaw)?

- Wo bricht Wall-Clock-Sync, wenn LoRa-Latenz reinkommt?

- Was ist der Demo-Wert für einen einzelnen Träger, ohne Netz?

- Sind Token-Kosten und Latenzen so, wie die γ-Heuristik vermutet?

- Lässt sich Decision-Transparency (Konfidenz + Quelle + Begründung pro Empfehlung) so umsetzen, dass sie für den Träger lesbar bleibt — nicht im Maschinen-Log versteckt?

Wenn die Demo trägt, ist die Tech-Hypothese validiert. Wenn nicht, war’s ein billiger Validator für das Eingeständnis, dass eine Lücke da ist, die mit dem aktuellen Substrat nicht zu schließen ist.

Parallel zu prüfen:

- HLC (Hybrid Logical Clocks) als Standard-Ordnung evaluieren, statt AgentClaws Phase-6-Migration blind zu starten

- Tier-3-Governance-Modelle vergleichen — Genossenschaft, Stiftung, Stadtwerke-Tier — welches trägt die Achse-A-Entscheidung?

- Self-Limiting-Mechanismen als Code skizzieren, nicht als Versprechen — inklusive der Decision-Level-Pflicht für jede Empfehlung

- Offen: ob ein eigenes LLM-OS (Karpathy 2024) für den Stack lohnt — gleicher Kernel von Wearable bis Resilience Center, statt generisches Modell mit verlustbehafteten Tier-Übergängen. Nur mit Uni- oder Industrie-Partner sinnvoll, der Modelltrainings-Kompetenz mitbringt.

- Offen: zwei-achsige Eigenzeit als Substrat —

γ_machine(AgentClaws CDC-Achse, Reasoning-Aufwand pro Wand-Sekunde) undγ_human(Stress-/Müdigkeits-bedingte Wahrnehmungs-Dehnung). Wenn ein Mesh beide Achsen kennt, kann es zwischen ihnen vermitteln — z.B. einer überlasteten Maschine sagen „liefere langsamere Sätze, dieser Mensch ist gerade in Stress-Dehnung“. Das ist nicht Phase-6-Kosmetik, das ist Forschungspfad mit echtem Use-Case.

Schluss

Ich weiß heute nicht, ob LogPy in zwei Jahren 100 oder 100.000 oder 1.000.000 Träger hat. Ich weiß nicht, ob Tier 3 von einer Genossenschaft oder vom THW oder von Hetzner betrieben werden wird. Ich weiß nicht, wie die Krise aussieht, in der das Netz das erste Mal wirklich gebraucht würde.

Was ich weiß: dass die erste Linie unter Lasten steht, denen sie nicht gewachsen ist. Dass eine zweite gerade nicht existiert. Dass die Bauteile für die zweite — kleine Modelle, Mesh-Funk, Agent-Protokolle, Identity-Stacks — alle bereits da sind und nur noch ehrlich zusammengesetzt werden müssten.

Dieses Paper ist ein Aufruf zur Mit-Forschung. Stimmen aus Katastrophenschutz, Distributed-Systems-Forschung, Mutual-Aid-Praxis, Krypto-Engineering, Politik-Theorie und Hardware-Engineering sind willkommen. Wo ich mich verrenne, sagt es mir. Wo ihr eigene Daten habt, die meine Hypothese prüfen oder widerlegen, sagt es mir auch.

Der nächste Beleg, den ich erbringen will, ist die 2-Device-Demo. Das ist das nächste Update, das hier erscheinen wird.

— H.G.O. Dillenberg, 2026-05-09

Anhang: Status der Komponenten

| Komponente | Status |

|---|---|

| AgentClaw Substrat (Phase 1–5) | gebaut, produktiv |

| AgentClaw Phase 6 (τ-basierte Eigenzeit) | offen, zurückgestellt |

| A2A-Endpoint (Single-Agent, JSON-RPC 2.0) | live auf rent-a-human.dillenberg.net |

| ALICE Single-Agent UI | live auf dillenberg.net/alice/ |

| Identity / Web-of-Trust | konzeptionell |

| HLC-Spike | nicht begonnen |

| 2-Device-Demo | nicht begonnen |

| Tier-3-Governance-Modell | offen |

Anhang: Beziehung zu existierenden Bewegungen

Wir bauen auf Schultern, nicht auf der grünen Wiese. Anschluss zu:

- Meshtastic — LoRa-Mesh-Stack, ~100 k Devices weltweit. Wir lernen vom Form-Faktor und vom Cold-Start-Verlauf.

- Briar — Bluetooth/Tor-P2P-Messaging, Identity-Layer ohne Server. Wir lernen vom Trust-Modell.

- Freifunk — WLAN-Mesh in DE, ~50 k Knoten, 20 Jahre Erfahrung mit Genossenschafts-Governance.

- Solid (Tim Berners-Lee) — Personal Data Pods. Wir lernen vom Daten-Souveränitäts-Konzept.

- A2A-Spec — Industrie-Standard für Agent-zu-Agent-Kommunikation, Basis unserer Tier-übergreifenden Protokoll-Schicht.

Wer von diesen Bewegungen kommt und in das Mesh-Bild reinpasst, ist willkommen. Was wir nicht versprechen: dass alles aus diesen Welten nahtlos kombinierbar ist. Was wir versprechen: dass wir es ehrlich versuchen werden.